این اپیزود در اردیبهشت ۱۴۰۴ منتشر شده است. چهارمین قسمت از فصل سوم پادکست «لایه هفتم» به موضوع هوش مصنوعی در ایران میپردازد. در این اپیزود بررسی میکنیم که آیا سرمایهگذاری عظیم دولت در حوزه هوش مصنوعی میتواند منجر به پیشرفت و عدالت شود یا برعکس، به ابزاری برای سرکوب، نظارت و بازتولید تبعیض بدل خواهد شد. در ادامه میتوانید متن کامل این اپیزود را بخوانید.

پویش: سلام. من پویش عزیزالدین هستم، درباره تکنولوژی و حقوق بشر تحقیق میکنم و این چهارمین اپیزود از فصل سوم پادکست لایه هفتمه. لایه هفتم در گروه فیلتربان تولید میشه در همکاری با رادیو فردا و ما اینجا درباره حقوق دیجیتال، حق دسترسی به اینترنت، ابزارهای عبور از فیلترینگ و برقراری ارتباط در زمان قطعی اینترنت و خلاصه هر آنچه ساکنان ایران در دنیای دیجیتال باهاش سر و کار دارند صحبتمیکنیم.

واقعاً این هوش مصنوعی که همه دارن ازش حرف میزنن، قراره زندگی ما رو بهتر کنه؟ یا فقط یه ابزار دیگهست برای کنترل آدمها و تثبیت وضع موجود؟

این سوال رو یکی از دوستان فعال اجتماعی باسابقهایه و سالهاست که میشناسمش چند هفته پیش ازم پرسید، کی؟ دقیقا همین اولین روزهای بعد نوروز سال چهار که عکسهای کاربران که توسط هوش مصنوعی کارتونی شده شبکههای اجتماعی فارسی رو پر کرده بود.

من به یکی از برنامه های تلویزیونی رفته بودم که توضیح بدم در مواجه ما با هوش مصنوعی داستان حریم خصوصی چی میشه و چه اطلاعاتی باید بدیم به این مدلها و چه اطلاعتی ندیم و خب بعدش در صفحه شخصیم و در صفحه فیلتربان با یک عالمه سوال مواجه شدم. اول بنا داشتم یه اپیزود راجع به مساله داده و حریم خصوصی در هوش مصنوعی بسازم. تا اینکه دوستمون این سوال رو پرسید. خودم هم مدتیه درگیر این سوالم. و البته این یه دغدغه جهانیه: اینکه این تکنولوژی واقعاً قراره ما رو آزادتر کنه؟ یا فقط شکل جدیدی از کنترل و بازتولید نابرابریهاست؟

خلاصه تو همین گیر و ویر خبری اومد که بعله معاونت علمی، فناوری ریاستجمهوری و صندوق توسعه ملی، تفاهمنامهای ۱۰۰ میلیون دلاری (معادل ۱۲۵۰۰ میلیارد تومان) جهت توسعه هوش مصنوعی در ایران امضا کردند. خب توسعه همیشه خوبه ما هم موافقیم ولی وقتی این خبر رو بذاری کنار چشم انداز و نگرش حکومت درباره هوش مصنوعی که خب خودشون در سند ملی هوش مصنوعی جمهوری اسلامی ایران قبلا اعلام شده اون وقت داستان متفاوت میشه.

اینه که فکر کردم الان وقت خوبیه که یه کم درباره این موضوع حرف بزنیم.

پس بریم برای شنید این اپیزود:

هوش مصنوعی بهخصوص اون مدلی که این روزها اسمش همهجا شنیده میشه، یعنی مدلهای زبانی و یادگیری ماشین اگه بخوایم خیلی ساده بگیم، یه جور سیستمِ یادگیرندهست. مثل بچهای که از شنیدن و دیدن دنیای اطراف، کمکم زبان یاد میگیره، هوش مصنوعی هم با خوندن میلیاردها جمله و تصویر و صدا، از دنیای ما آدمها "منطق" استخراج میکنه.

ولی فرقش اینه که این سیستمها نه اخلاق دارن، نه تجربه، نه انصاف. فقط داده دارن. اون موقع هم که ما این داده رو به اینا میدیم اینجوری هستیم که داده رو کی داده کی گرفته. در حالی که ماشینها بدون هیچ قضاوت اخلاقی، نابرابری و تبعیض رو میگیرن بازتولید میکنن، و حتی ممکنه تقویت کنن.

مردیث بروسارد در کتاب ناهوش مصنوعی یا بی هوش مصنوی یا آرتیفیشال آن اینتلجنس یه مثال جالبی آورده.، یه مدل هوش مصنوعی رو با عکسهای سلفی محبوب یعنی اونایی که زیاد لایک خوردند در شبکههای اجتماعی آموزش داده بودن. نتیجه؟ عکسهایی که بعدتر هوش مصنوعی به عنوان «سلفی خوب» تشخیص میداد، بیشتر مربوط میشد به زنهای جوان، سفیدپوست، و مطابق با استانداردهای زیبایی غربی. نه چون اون مدل قصد بدی داشت—چون یاد گرفته بود چیزی که تو اینترنت محبوبتره، یعنی "خوبه".

مشکل ما همین جاست. چون اگر "محبوبیت" رو معیار خوب بودن بدونیم، یادمون میره که چقدر از این محبوبیتها، حاصل تبعیضهای تاریخی، حذف صداها، و فیلترهای نابرابرن. مثلاً در ایران، به خاطر رسمی بودن زبان فارسی و نبود آموزش به زبان مادری، میلیونها نفر از مردم کرد، ترک، بلوچ یا عرب، نهتنها از حق زبانیشون در دنیای واقعی محرومان، بلکه محتوای دیجیتال کمی هم به زبانشون تولید میشه. این یعنی مدلهای زبانیِ هوش مصنوعی فارسیمحور، در آینده بهندرت تجربههای زبانی و فرهنگی این گروهها رو درک میکنن یا بازتاب میدن.

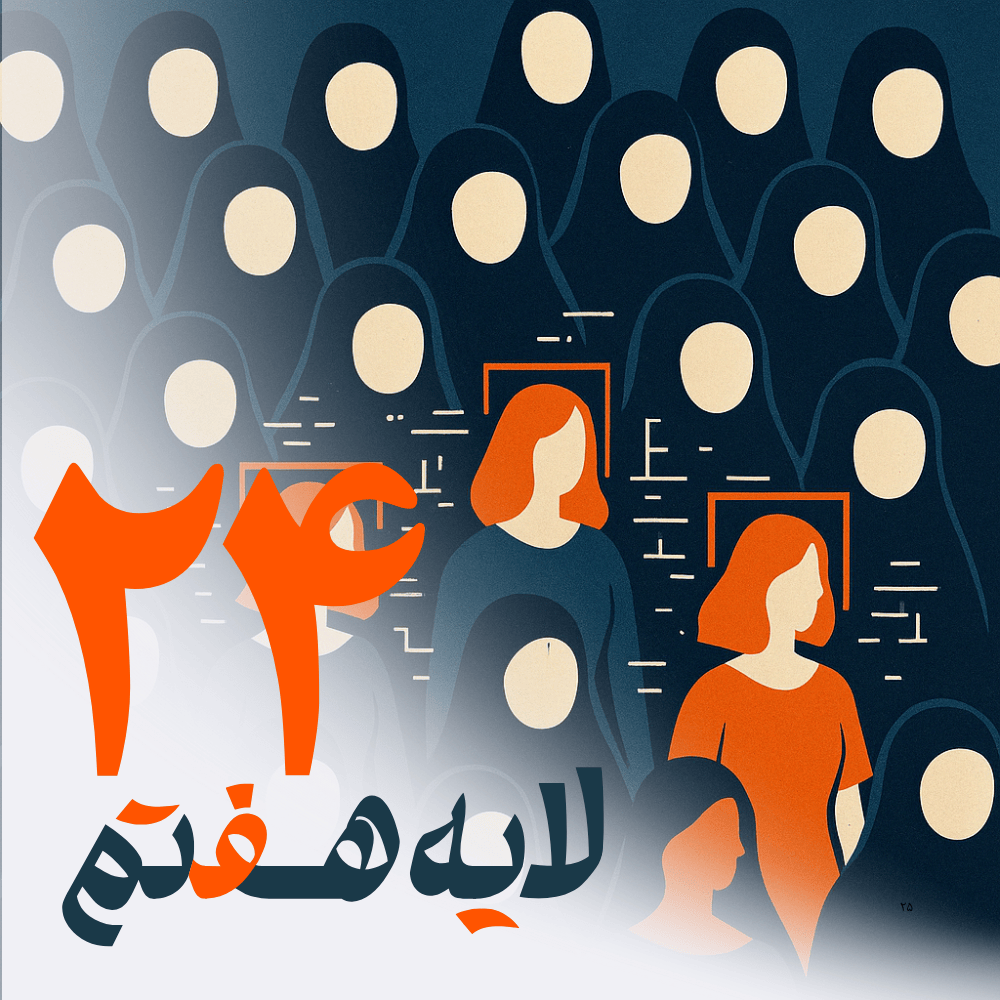

یا مثلا تصور کنید که شناخت هوش مصنوعی از زن ایرانی براساس روایت رسمی یا سانسور شده باشه. که دربرگیرنده همه سلایق نیست. این موضوع میتواند باعث تحلیلها و خروجیهای نادرست شود؛ و خب ممکنه این هوشمصنوعه در یک سامانهای زن بیحجاب ایرانی را بهطور خودکار «ناهنجار» طبقهبندی کنه.

در واقع اینجا یک روایت رسمی عملا داره به این ماشینها یاد میده که جهان چه شکلیه یا بهتر بگم، چه شکلی باید باشه.

بعضیها فکر میکنن تکنولوژی، چون بر اساس عدد و منطق ساخته شده، بیطرفه. اما حقیقت اینه که کسی که اون پشت نشسته داره کد مینویسه که بی طرف نیست. و شاید در دنیای امروز هیچ چیز به اندازهی یک نفر که پشت نقاب فناوری پنهان شده و داره دونسته یا ندونسته یک کد ناعادلانه مینویسه خطرناک و ترسناک نیست.

یک کد ناعدلانه یک الگورتیم حاوی سوگیری، تبعیض رو سیستماتیک میکنه و تبدیلش میکنه به چیزی که بهش میگن نابرابری مهندسیشده.

در اپیزود قبلی درباره پیامکهای حجاب در اصفهان گفتیم و در این فاصله هم ما یک گزارش خیلی خوب و مفصل در فیلتربان در اینباره منتشر کردیم که پیشنهاد میکنم برید بخونید. که چطور تکنولوژی در خدمت سرکوب درمیاد و حالا تصور کنید که این سامانهها به روز بشن و به هوش مصنوعی هم مجهز بشن.

اسمش رو هم میذارن هوشمند سازی یا پیشرفت فناورانه.

روها بنجامین، میگه گاهی اون چیزی که به اسم "پیشرفت" تبلیغ میشه، در واقع فقط یه نسخهی دیجیتالشده از همون تبعیضهای قدیمیه. تبعیضهایی که حالا دیگه نه از زبان قاضی یا مامور، بلکه از زبان ماشین بیرون میاد.

پویش: حالا بیا برسیم به ایران. …

پویش: حالا بیا برسیم به ایران. به اینکه وقتی این سیستمها – هوش مصنوعی، الگوریتمها، مدلهای زبانی – تو یه کشوری مثل ایران توسعه پیدا میکنن، چی ممکنه ازشون در بیاد. خبری داریم از ایران در این زمینه

پروانه: سند ملی هوش مصنوعی رو وقتی میخونی خودش خیلی چیزا رو روشن میکنه. از همون صفحه اول، تأکید روی «تمدن نوین اسلامی» و «حکمرانی هوشمند اسلامی» داره. یعنی یه جور نگاه ایدئولوژیک که مشخص میکنه اولویت چی قراره بشه

پویش: دقیقاً. حالا خیلی انتظار گنده ایه که مثلا بگیم از آزادی بیان یا حقوق مثلا اقلیتها در این سند چیزی گفته شده باشه ولی حتی از موضوعات بدیهی مثل ا حق حریم خصوصی، دسترسی برابر به اطلاعات هم خبری نیست و طبق معمول. تمرکز اصلی سند حفظ اقتداره نظام و حکمرانی، نه محافظت از کاربر

پروانه: تو ۳۹ اولویتهای سند رو نگاه کنی و کلیدواژه هارو که بررسی کنی، میبینی پرتکرارترین کلیدواژهها مربوط به کنترل، امنیت، دفاع و دولت هوشمنده. انگار قراره AI ابزار نظارت باشه، نه ابزار آزادی یا مشارکت.

پروانه: در عین نقش جامعه مدنی و بخش خصوصی هم کلا حذف شدند

پویش: این حذف، اتفاقی نیست و توسعه هوش مصنوعی دست نهادهای امنیتی است و به نفع اونها و . نه برای مردم.

پویش: خب میشه گفت که روشی که دولت داره برای توسعه هوش مصنوعی پیش میبرد یک جوری انحصارطلبانه است و نه بر محور نه توسعه

پروانه: و اونوقت پیشبینی هم کردند که تا سال ۱۴۱۰ ایران باید جز ده قدرت برتر جهان در هوش مصنوعی باشه. ولی بازهم معلوم نیست که مسئول پیشبرد این برنامه کیه .

پویش: من نمیدونم چطور میخوان به این رتبه برسند همین حالا عربستان رتبه ۱۴ جهانی رو داره در این زمینه و تازه داره برسی میکنه ۱۰۰ میلیارد دلار هم سرمایه گذاری جدید کنه. حالا من نمیگم عربستان الگوی توسعه است ولی نمیشه که فقط با نگاه قهری به جهای بیایم و حرف از توسعه هوش مصنوعی بزنیم و هیچ سازو کاری دقیقی هم ارائه نکنیم.

پروانه: همین نگاه رو تو سخنان دبیر شورای عالی انقلاب فرهنگی هم دیدیم. چند وقت پیش گفته بود باید چتباتهای اسلامی طراحی کنیم تا با جهانبینی غربی مقابله کنیم، یعنی از نظر اونها مدلهای زبانی هم باید ایدئولوژیک باشن.

پویش: خب تقریبا مثل نگاهشون تو تمام عرصههای فناورانه منتهی یه کم اغراقآمیزتر..

پروانه: شنیدی که حسن عندلیب مدرس حوزه گفته باید در آینده زندانهایی برای رباتهای هوش مصنوعی بسازیم. خلاصه به زودی شاهد افتتاح اولین زندان ویژه رباتها در ایران خواهیم بود؛

پویش: فقط مونده ببینیم سلول انفرادیشون وایفای داره یا نه! ما یه جارو برقی از این هوشمندا داریم باید نصیحت کنم خطایی نکنه!

پروانه: شما وضع تون خیلی خوبه استاد: )

پویش: چیز دیگهای که این میان هست اینه که استارتاپها، توسعه دهندههای مستقل، در دسترسی و دریافت تسهیلات برای استفاده از هوش مصنوعی عملا حذف شدن. یعنی رشد و توسعه فقط برای گروههاییکه «مورد اعتماد» باشن.

پروانه: و هیچ شفافیتی هم تو فرآیند انتخاب پروژهها یا ارزیابی اونها نیست. این یعنی دروازهبانی بهنفع قدرت، نه بهنفع نوآوری.

پویش: در نهایت هم هدف سند توسعه هفتم اینه که اقتصاد دیجیتال ۱۰ درصد از تولید ناخالص داخلی رو تشکیل بده. ولی سؤال مهم اینه: بدون آزادی بیان، بدون دسترسی آزاد به اطلاعات، و بدون مشارکت واقعی، واقعاً قراره این هدف چطوری محقق بشه؟

پروانه. معلومه که محقق نمیشه اگر یه فضای فراگیر که اعتماد و گفتگوهست وجود نداشته باشه. تکنولوژی و پیشرفت که فقط سخت افزار نیست بدون آزادی و برابری فقط یه اسم قشنگه

پایانبندی

جالبه بدونید نگرانیهایی که مطرح کردیم، در سطح بینالمللی هم دیده شده. مثلاً یه گزارش مهم از اندیشکده پارلمان اروپا، دقیقاً به همین پدیده «اقتدارگرایی الگوریتمی» پرداخته و نشون میده چطور دولتهایی مثل ایران، از هوش مصنوعی بهعنوان «سلاح سرکوب» برای تشدید نظارت و کنترل اجتماعی استفاده میکنن. مخصوصاً وقتی این فناوری با پروژهای مثل شبکه ملی اطلاعات ترکیب بشه، قدرتش برای کنترل محتوا، غالبکردن روایت رسمی، و مختلکردن گردش آزاد اطلاعات چند برابر میشه و عملاً به ابزاری برای نقض حقوق دیجیتال تبدیل میشه.

اما این فقط یکروی سکهست.

هوش مصنوعی، مثل خیلی از فناوریهای دیگه، یه دلیماست—یعنی هم میتونه برای سرکوب بهکار بره، هم برای توانمندسازی.

درسته که حکومتها دارن از مدلهای زبانی بزرگ، چه وارداتی چه ساخت داخل، برای حذف صداهای مخالف استفاده میکنن. اما ما هم، بهخصوص کسایی که دانش و دسترسی دارن، میتونیم از مدلهای زبانی کوچکتر، رایگان و بازمتن برای ساخت ابزارهای مقاومتی استفاده کنیم: از ترجمه و تولید محتوای جایگزین گرفته، تا آموزش زبانهای به حاشیهراندهشده، یا تحلیل نقدهای سانسور شده.

نکتهی امیدوارکننده اینه که استفاده از این ابزارها داره هر روز سادهتر میشه. یعنی دیگه فقط متخصصها نیستن که میتونن ازشون استفاده کنن. اگر اونهایی که بلد هستن، دانششون رو با بقیه به اشتراک بذارن، میتونیم از دل همین فیلترها، یه مقاومت دیجیتال جمعی بسازیم مشارکتی، پر صدا، و چندزبانه.

ما هم اولین کسانی نیستیم که با این مساله مواجه میشه. چه در مساله جنسیت و چه در مساله قومیت و نژادی، دنیا با این مساله روبرئه. تجربه اونها به ما یاد میده که اول باید سوگیریها رو بشناسیم، بعد زیر سوال ببریم، بعد برای شفافیت، پاسخگویی و بازنگری عمومی این ماشینها فشار بیاریم. و مهمتر از اون، بفهمیم که فقط مصرفکنندهی فناوری نیستیم بخصوص در بحث هوش مصنوعی که از داده های ما میآموزه و بهمون نسبت میتونیم بخشی از تغییر باشیم.

ما هنوز هم میتونیم روایت رو تغییر بدیم. البته شخصا معتقدم این مسیر همین حالا هم شروع شده و خب از دل همین گفت و گوها و اطلاع رسانیها به پیش میره.

ممنونم که با من همراه بودید.

تشکر ویژه میکنم از همکارم پروانه وحیدمنش که لطف کرد در اجرای این اپیزود هم همراه من بود، تیم تک سازمان میان در گروه فیلتربان و دوستان خوبمون در رادیو فردا.

پس فعلا خدافظ و یادمون نره که در دنیای امروز دسترسی به اینترنت و آگاهی از حقوق دیجیتال یک حق مسلم و پذیرفته شده است.

منابع مورد استفاده در این اسکریپت:

گزارشها:

مقالات و منابع خبری:

- حذف بخش خصوصی از هوش مصنوعی (دنیای اقتصاد)

- هشدار درباره چتباتها (خبرگزاری مهر)

- هوش مصنوعی و حجاب (زومیت)

- تأمین مالی پروژههای هوش مصنوعی (پیوست)

- سرمایهگذاری ۱۰۰ میلیون دلاری برای توسعه هوش مصنوعی در ایران

- ارتقای جایگاه ایران در شاخص جهانی آمادگی دولت در زمینه هوش مصنوعی

سند سیاستی:

سایر منابع مفهومی:

کتابها: